Pubblicazione iniziale 2023/10/25 10:21. Ultimo aggiornamento: 2023/10/27 00:30.

Questa sera alle 20.30 sarò uno degli ospiti del Film Festival Diritti Umani, che si sta tenendo a Lugano dal 19 al 25 ottobre, insieme a Bruno Giussani (curatore internazionale di TED) con la moderazione della giornalista RSI Michèle Volonté. Vedremo il documentario Another body di Sophie Compton e Reuben Hamlyn (in inglese con sottotitoli in italiano) e ne discuteremo con il pubblico dopo la proiezione, che inizia alle 20.30 al cinema Corso, in via Pioda 4.

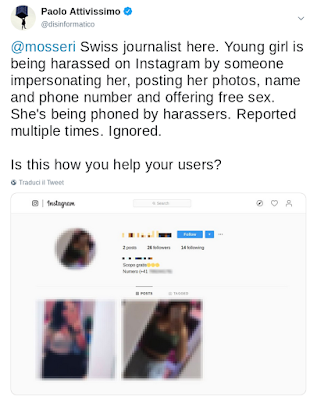

Il tema dei diritti umani può sembrare insolito da trattare per chi si occupa principalmente di informatica, ma in questo caso è proprio l’informatica a stravolgere un diritto umano fondamentale, rendendo possibile una nuova forma di abuso: il deepfake di immagini intime non consensuali, ossia l’uso di software per creare e diffondere foto e video che applicano realisticamente il volto di una vittima (quasi sempre una donna) a scene di sesso in realtà interpretate da altre persone, allo scopo di molestarle o umiliare pubblicamente quella vittima.

Non chiamatelo revenge porn: è profondamente sbagliato, perché sottintende erroneamente che la vittima abbia commesso qualche azione che giustifica una vendetta da parte di chi produce e diffonde questi video, e non è pornografia, perché la pornografia è consensuale: gli interpreti scelgono di essere ripresi e che la loro immagine intima venga diffusa.

Il documentario Another Body racconta in dettaglio la vicenda di una giovane donna che diventa vittima di un deepfake che la mostra e che viene pubblicato su Pornhub, sconvolgendo la sua vita. Non contiene immagini esplicite, ma vi allude molto chiaramente, e soprattutto tocca un tema molto delicato e sempre più diffuso, per cui il Festival ne consiglia la visione alle persone dai 15 anni in su.

Per chi avesse bisogno di risorse contro questa piaga:

- StopNCII.org (elenco dei link diretti per le segnalazioni sui principali social network)

- Revenge Helpline (elenco delle fonti di aiuto nei vari paesi)

- Svizzera: pagina di segnalazione al Centro nazionale per la cibersicurezza NCSC

- Italia: Permesso negato APS (no-profit di supporto tecnologico e feedback legale)

2023/10/27

È stata una serata molto intensa: molte persone in sala sono rimaste scioccate da quello che hanno visto, perché non avevano idea dell’esistenza di questo fenomeno e di quanto fosse facile produrre questi deepfake oggi, ma soprattutto non immaginavano che qualcuno (anzi, ben più di un occasionale qualcuno) potesse arrivare a tanto. Alcune persone hanno lasciato la proiezione, profondamente scosse. Nel dibattito dopo il film, Bruno Giussani ed io abbiamo cercato di offrire risorse e rimedi per almeno contenere il danno di questi abusi. Su La Regione c’è un articolo di Ivo Silvestro (paywall) che parla del documentario e del dibattito con il pubblico.

Aggiungo qui un link a un caso di deepfake politico avvenuto proprio pochi giorni fa qui in Svizzera a pochi giorni dalle elezioni federali: un video falso pubblicato lunedì scorso da un consigliere nazionale dell’UDC, Andreas Glarner, che mostra un deepfake in cui la deputata dei Verdi Sibel Arslan sembrava pronunciare slogan a favore dell’UDC. La deputata si è rivolta al tribunale civile di Basilea, che ha ottenuto la cancellazione del video. Gli altri partiti hanno condannato l’uso di deepfake in campagna elettorale; l’UDC ha scelto di difendere “quello che definisce il diritto alla satira” (Rsi.ch, 18 ottobre).

Infine allego un parere del Consiglio Federale sui deepfake, datato 16 agosto 2023 (i grassetti sono aggiunti da me):

Salvo poche eccezioni (p.es. in alcuni Stati federali americani e in Cina), a livello internazionale non esistono regolamentazioni specifiche sui deepfake, nemmeno nell’Unione europea. Un riferimento esplicito ai sistemi che generano deepfake esiste solo nell’attuale progetto di ordinanza sulla definizione di prescrizioni armonizzate per l’intelligenza artificiale (IA). La Commissione europea considera questi sistemi «a basso rischio». Secondo la bozza di ordinanza i deepfake devono essere in linea di principio resi noti. Il progetto di ordinanza sulla definizione di prescrizioni armonizzate per l’intelligenza artificiale è ancora in fase di negoziazione all’interno dell’UE. Varie altre basi legali presenti nell’UE possono essere applicate ai deepfake, tuttavia non sono esplicitamente mirate ad essi. Inoltre, la Commissione europea sta cercando di aggiungere al codice di condotta volontario contro la disinformazione alcuni passaggi sui deepfakes generati dall'IA.

Attualmente in Svizzera non sembra opportuno elaborare una regolamentazione specifica per i deepfake. Tuttavia, è possibile prevedere che in futuro occorra una regolamentazione per quanto riguarda l'aspetto generale dell'IA. Attualmente in Svizzera non sembra opportuno elaborare una regolamentazione specifica per un singolo aspetto. Tuttavia, non si può escludere che in futuro occorra una regolamentazione per quanto riguarda l'aspetto generale dell'IA. Il Consiglio federale segue da vicino gli sviluppi legali in materia, in particolare nell'Unione europea.

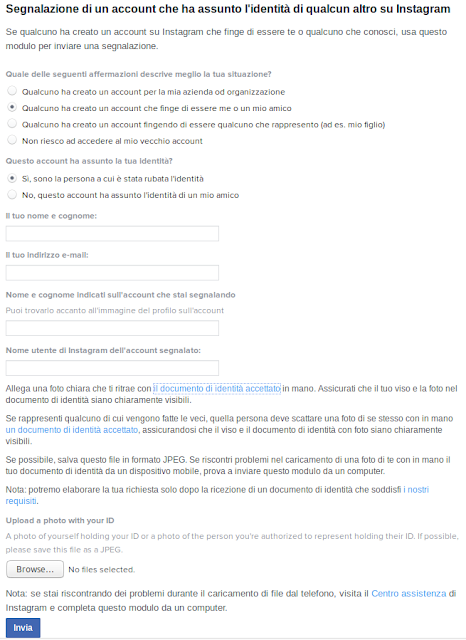

Il 5 aprile 2023 il Consiglio federale ha incaricato il DATEC di preparare, entro fine marzo 2024, un avamprogetto da porre in consultazione per regolamentare le piattaforme di comunicazione. Si valuta, tra le altre cose, l’opportunità di introdurre un obbligo per queste ultime di adottare una procedura di notifica e azione («notice and action»). Agli utenti viene così data la possibilità di segnalare facilmente i contenuti potenzialmente illegali. Le piattaforme di comunicazione dovrebbero valutare le segnalazioni ricevute ed eventualmente rimuovere i contenuti. Se dovessero essere realizzati contenuti illegali tramite deepfake, si applicherebbe questa procedura di notifica.

Sul piano penale, il Consiglio federale ritiene che non vi siano lacune legislative per quanto riguarda l’utilizzo delle applicazioni per deepfake. Sostanzialmente il Codice penale svizzero è concepito per essere neutro dal punto di vista tecnologico. Esso si applica indipendentemente dalle tecnologie impiegate dall’autore. Ad esempio, se l’autore utilizza la tecnologia deepfake per commettere un delitto contro l’onore o la sfera privata, sono applicabili le corrispondenti disposizioni (art. 173 segg. CP; in particolare anche le nuove disposizioni contro l’usurpazione d’identità che entreranno in vigore il 1° settembre 2023, art. 179decies CP). Se l’autore manifesta un’intenzione più ampia attraverso l’uso di deepfake, ad esempio per ottenere un vantaggio pecuniario con l’inganno, si applicano le fattispecie penali corrispondenti nell’ambito del diritto penale patrimoniale. Il riferimento a singole tecnologie non offrirebbe un valore aggiunto, bensì metterebbe in discussione la completezza del diritto penale vigente in relazione ad altri sviluppi tecnologici.

Le stesse considerazioni valgono per il diritto civile: indipendentemente dalle tecnologie impiegate si possono applicare in particolare le disposizioni sulle lesioni alla personalità (ovvero il diritto sulla propria immagine e la propria voce, il diritto al rispetto della sfera intima e privata, il diritto all’onore) e i rispettivi mezzi di ricorso (ovvero cessazione, divieto). Ciò vale anche per la responsabilità per atti illeciti, anch’essa neutrale dal punto di vista tecnologico e applicabile in caso di violazione dei diritti tramite l’impiego di deepfake, sempreché i relativi requisiti siano adempiuti.

Infine, va ricordato il principio dell'esattezza dei dati sancito dall'articolo 6 capoverso 5 della nuova legge sulla protezione dei dati (nLPD; RS 235.1) secondo cui, chi tratta dati personali deve accertarsi della loro esattezza.

2023/10/30

Rassegna stampa: Tio.ch. Foto: galleria del FFDU.