Oggi alle 19 sarò in diretta streaming su YouTube con Tesla Owners Italia per parlare di auto elettriche, viste le ultime notizie di cronaca sugli incendi di questi veicoli, sul “richiamo” di due milioni di Tesla, sulla produzione delle batterie che emette più CO2 di un’auto termica e sull’aumento dei consumi di carbone che sarebbe legato alle auto elettriche. Parleremo insomma della malinformazione e le fake news in circolazione sul tema, e ci sarà spazio per parlare delle conclusioni della COP28 con chi ha vissuto dal vivo a Dubai le fasi finali della conferenza: Domenico Vito di Climate Reality Project. Si parlerà anche del Cybertruck e del mercato delle auto elettriche con Carlo Bellati di Automoto.it, e parteciperanno anche Daniele Invernizzi e Pierpaolo Zampini. La diretta sarà coordinata da Luca De Bo.

Un blog di Paolo Attivissimo, giornalista informatico e cacciatore di bufale

Informativa privacy e cookie: Questo blog include cookie di terze parti. Non miei (dettagli)

Prossimi eventi pubblici – Sostegno a questo blog – Sci-Fi Universe

Cerca nel blog

2023/12/18

2023/10/12

Podcast RSI - Vaccinarsi contro le fake news: il “prebunking”

È disponibile subito il podcast di oggi de Il Disinformatico della Radiotelevisione Svizzera, scritto, montato e condotto dal sottoscritto: lo trovate qui sul sito della RSI (si apre in una finestra/scheda separata) e lo potete scaricare qui.

Le puntate del Disinformatico sono ascoltabili anche tramite iTunes, Google Podcasts, Spotify e feed RSS.

Buon ascolto, e se vi interessano il testo di accompagnamento e i link alle fonti di questa puntata, sono qui sotto.

---

[CLIP: Audio di uno degli attacchi di Hamas]

Il recente attacco di Hamas in Israele ha scatenato una nuova ondata di disinformazione sui social network, tanto che l’Unione Europea ha inviato una lettera di monito a X, il social nework un tempo noto come Twitter, avvisando che la sua mancata rimozione delle fake news su questo terribile tema rischia di essere in violazione delle leggi europee. Ma tutti i social network sono da sempre bacino fertile per le informazioni false e pubblicare le smentite sembra essere inutile.

Due università britanniche, però, propongono un’altra soluzione: la cosiddetta teoria dell’inoculazione. Una sorta di “vaccinazione” contro le fake news, un’azione preventiva che permetterebbe alle persone di diventare più resistenti alla disinformazione in generale e di respingerla, come avviene con le malattie. Il procedimento che descrivono è semplice e indolore, e si può eseguire in tanti modi, anche attraverso giochi online e persino tramite un podcast come questo.

Benvenuti alla puntata del 13 ottobre 2023 del Disinformatico, il podcast della Radiotelevisione Svizzera dedicato alle notizie e alle storie strane dell’informatica. Io sono Paolo Attivissimo.

[SIGLA di apertura]

X e i social non fanno abbastanza contro le fake news

Pochi giorni fa Thierry Breton, Commissario per il mercato interno dell’Unione Europea, ha inviato una lettera aperta a Elon Musk, avvisandolo che il suo social network, noto per anni come Twitter e ora chiamato X, viene usato per diffondere disinformazione e contenuti illegali, violenti e terroristici dopo l’attacco di Hamas a Israele e che nonostante le segnalazioni fatte anche dalle autorità X non ha rimosso prontamente questi contenuti, come è invece richiesto dalle leggi europee e in particolare dal Digital Services Act, entrato in vigore a novembre scorso. Una inadempienza continuata potrebbe portare a sanzioni economiche considerevoli contro X e anche alla sospensione del servizio in Europa (BBC).

[Bretton ha inviato analoga intimazione a Meta (RSI; Reuters); dopo la chiusura del podcast ha inviato a X anche richiesta formale in base al DSA]

Questo monito fa il paio con un recente rapporto dell’Unione Europea che indica che la disinformazione è più prevalente su X che sugli altri social network (Ars Technica).

Questa piaga, insomma, continua a diffondersi e le azioni prese fin qui non sembrano essere state efficaci nel contrastarla. Le notizie false viaggiano velocissime, ma le loro smentite non riescono a fare altrettanto: il cosiddetto debunking, ossia la spiegazione pubblica e documentata delle bugie diffuse dalle fake news, pare poco efficace.

Per citare Jonathan Swift, le falsità volano, mentre la verità le rincorre zoppicando (“Falsehood flies, and the Truth comes limping after it”, in The Examiner, 1710). Se vi ricordavate questa citazione in una forma differente, qualcosa del tipo “una bugia fa mezzo giro del mondo nel tempo che ci mette la verità a infilarsi le scarpe”, e ve la ricordate attribuita a Mark Twain, confermate involontariamente questo fenomeno, perché Twain non ha mai detto nulla del genere, come hanno scoperto gli esperti di Quote Investigator, ma la falsa attribuzione continua a girare nonostante la smentita sia pubblicamente disponibile da tempo.

Un recente lavoro delle università britanniche di Cambridge e Bristol propone invece un approccio preventivo, che consiste nel dare alle persone gli strumenti per riconoscere facilmente i sintomi tipici dei tentativi di disinformazione e quindi, in un certo senso, dare loro gli “anticorpi” digitali necessari per contrastare la malattia della disinformazione. I ricercatori etichettano questo approccio con un nome molto formale, ossia teoria dell’inoculazione, attingendo proprio al lessico medico delle vaccinazioni, ma a volte usano anche un termine più conciso, ossia prebunking: in pratica, un debunking preventivo.

Il lavoro di queste università è disponibile presso il sito Inoculation.science, e sulla rivista Science Advances è stato pubblicato nel 2022 un articolo scientifico (Psychological inoculation improves resilience against misinformation on social media) che spiega come funziona il prebunking e dimostra che è efficace. Vediamo insieme quali sono i suoi ingredienti e come metterli in pratica.

Il vaccino anti-fake news

La teoria dell’inoculazione psicologica, per citarla con il suo nome completo, non è una novità: viene già studiata da una sessantina d’anni e si basa su due componenti fondamentali. Il primo è un preavviso emotivo, che dice che sta per arrivare un attacco a un’idea alla quale crediamo e ci mette in guardia; il secondo è una microdose indebolita di disinformazione, che contiene già una smentita preventiva.

Per esempio, si può diffondere un preavviso emotivo che segnali che ci sono persone che cercheranno di convincerci che la Terra è piatta e poi si possono spiegare le prove della rotondità della Terra e indicare quali sono gli errori di ragionamento dei terrapiattisti.

Il limite di questo approccio è che la smentita è specifica, un po’ come i vaccini biologici. Questo tipo di inoculazione rende quindi più resistenti a una singola tesi alternativa. Ma ogni giorno nascono e si diffondono nuove tesi di complotto, e servirebbe un numero infinito di inoculazioni psicologiche mirate.

Così, i ricercatori propongono oggi una nuova versione di questo metodo: invece di tentare di smontare preventivamente ogni singola teoria di complotto o diceria falsa, suggeriscono di concentrarsi sul riconoscimento delle tecniche di manipolazione e sulle strategie retoriche usate abitualmente dalla disinformazione di ogni genere. Questo permette di usare una singola “vaccinazione” generalista che vale per tutte le situazioni, offrendo una resistenza ad ampio spettro alle notizie false.

Per mettere alla prova questo approccio, i ricercatori hanno creato dei brevi video che presentano cinque tecniche di manipolazione che si incontrano spesso nella disinformazione.

-

La prima tecnica è il linguaggio emotivo. Le ricerche mostrano che l’uso di parole emotivamente cariche aumenta il potenziale di diffusione di un messaggio, specialmente se queste parole evocano sentimenti negativi come la paura, il disprezzo o l’indignazione. Per esempio, il titolo “Aumenta la disoccupazione giovanile” è una descrizione neutra di un fatto e lascia relativamente indifferenti. Ma “Giovani sempre più angosciati e senza lavoro” ha un impatto emotivo molto più forte.

-

La seconda tecnica è l’incoerenza, cioè l’uso di due o più argomentazioni che non possono essere tutte vere e si contraddicono. Per esempio, i terrapiattisti sostengono che gli scienziati nascondono la verità sulla forma della Terra, ma poi citano quegli stessi scienziati quando dicono qualcosa che sembra sostenere la teoria della Terra piatta. La maggior parte della gente non nota queste incoerenze se non viene abituata a cercarle.

-

La terza tecnica di manipolazione usata dalla disinformazione e descritta dai ricercatori è la falsa dicotomia o falso dilemma, che consiste nel presentare due alternative come se fossero le uniche possibili e nascondere il fatto che in realtà quelle alternative non si escludono a vicenda e che ci sono anche altre soluzioni. In uno dei loro video, i ricercatori citano come esempio Star Wars e in particolare Anakin Skywalker e il suo celebre “Se non sei con me, sei il mio nemico!”, rivolto al suo mentore e maestro Obi-Wan Kenobi [CLIP: Anakin vs Obi-Wan, da La vendetta dei Sith]. È una falsa dicotomia, perché non essere d’accordo non vuol dire per forza essere nemici; si può anche criticare una persona alla quale si vuole bene. E infatti Obi-Wan risponde perfettamente: “Soltanto un Sith vive di assoluti”.

-

Al quarto posto delle tecniche adoperate dai seminatori di fake news c’è l’indicazione del capro espiatorio: dare la colpa di un problema comune a qualcuno, o a un gruppo di persone, che non c’entra nulla. I ricercatori citano South Park - Il Film, in cui i genitori indignati decidono che i comportamenti antisociali dei loro figli sono colpa del Canada [CLIP: brano della canzone Blame Canada tratta dal film], ma la storia e la cronaca sono piene, purtroppo, di esempi tragici di questo genere.

-

Quinta, ma non ultima, è la tecnica dell’attacco ad hominem, ossia prendere di mira la persona che propone un’argomentazione invece di discutere la validità o meno di quello che dice. È un metodo classico, che serve per sviare l’attenzione dal vero tema e dirigerla contro un individuo. È vero che la credibilità di chi propone un messaggio a volte può essere pertinente, come nell’esempio, proposto dai ricercatori, di un fabbricante di sigarette che dovesse presentare uno studio che sostiene che il fumo non fa male, ma di solito gli attacchi ad hominem si concentrano su qualche caratteristica della persona che non c’entra nulla con l’argomento, magari un attributo fisico o la sua nazionalità.

Oltre ai video, i ricercatori hanno anche realizzato dei giochi online che simulano le attività sui social network e insegnano ai giocatori a riconoscere queste tecniche di manipolazione. L’obiettivo, insomma, è allenare le persone a notare i sintomi tipici dei tentativi di influenzarle. La speranza è che se questi sintomi vengono notati, verranno neutralizzati.

Sembra un’idea interessante, ma funziona davvero?

Risultati del prebunking

I ricercatori hanno messo alla prova la propria teoria in due modi: hanno presentato a gruppi di soggetti questi video di inoculazione, che mettevano in guardia contro queste tecniche di manipolazione, oppure dei video neutri, e poi hanno proposto a questi soggetti degli esempi di post nello stile di Twitter/X e Facebook. Alcuni di questi post usavano le tecniche segnalate; altri no. Un esperimento analogo è stato realizzato anche su YouTube, con una campagna pubblicitaria ad ampio raggio che ha raggiunto oltre cinque milioni di persone.

I dati di entrambi i test indicano che chi è stato inoculato contro le tecniche di disinformazione migliora la propria capacità di riconoscere le situazioni che usano queste tecniche, diventa più abile nel distinguere i contenuti affidabili da quelli inattendibili e tende a condividere meno contenuti ingannevoli rispetto a chi non ha ricevuto questa inoculazione.

Nell’esperimento fatto su YouTube, quindi in condizioni meno da laboratorio e più vicine alla realtà dei social network, il riconoscimento delle tecniche è aumentato in media del 5%; non è tantissimo, ma i ricercatori notano che il costo di una campagna di inoculazione contro le fake news fatta in questo modo è modestissimo (circa 5 centesimi per ogni visualizzazione del video), per cui sembra che valga la pena di fare l’investimento, soprattutto se si riesce a convincere i social network a sostenere almeno in parte i costi di una campagna socialmente utile.

Il prebunking fatto sui sintomi generici della disinformazione, invece di affrontare le singole teorie, ha anche un altro vantaggio importante oltre al suo ampio spettro di efficacia: evita di prendere di petto una visione del mondo emotivamente radicata e di creare una situazione di rifiuto e chiusura.

Soprattutto nelle tesi complottiste, infatti, la credenza non si basa solo sulle informazioni false, ma si fonda anche sulle emozioni legate a quelle informazioni e al senso di appartenenza a un gruppo che condivide quella credenza e quelle emozioni. Chiunque abbia un amico o un familiare rapito dalle tesi di cospirazione si riconosce esattamente in questa descrizione. Cercare di smontare una situazione del genere correggendo solo le informazioni sbagliate non funziona, perché la correzione diretta viene vista come un attacco frontale al proprio sistema di valori e quindi viene respinta in blocco. Un prebunking indiretto, nel quale ci si limita a far notare certe incongruenze di contorno, ha più possibilità di fare lentamente breccia.

Dato che è molto difficile sradicare credenze basate sulla disinformazione, la ricerca si sta insomma orientando verso metodi che aiutino le persone a resistere alla disinformazione in partenza, preventivamente, e questo approccio di inoculazione, ispirato dalla medicina e mirato a far crescere nelle persone gli “anticorpi mentali” generalisti che permettano di riconoscere e neutralizzare i tentativi di manipolazione emotiva più diffusi, sembra una strada promettente contro le teorie complottiste e le forme di disinformazione presenti e future.

Resta ancora da capire quali siano i canali e i messaggeri più efficaci per la comunicazione di questi anticorpi, quanto duri l’effetto dell’inoculazione e se ci sia un effetto anche su chi è già stato colpito dal virus della disinformazione. Ma questo approccio sicuramente costa poco, la prima dose l’avete già ricevuta tramite questo podcast, e l’unico effetto collaterale è un’opinione pubblica che si fa manipolare meno facilmente. Tutto sommato, sembra un rischio accettabile.

2023/07/27

(AGG 2023/08/18) Antibufala: nave in fiamme con 3000 auto a bordo, la Guardia Costiera non ha detto che è colpa di un’auto elettrica. E le elettriche sono tutte intatte, incendio scoppiato altrove

Il Corriere della Sera, in un articolo firmato da Maurizio Bertera, titola “Nave in fiamme con 3 mila auto a bordo: un morto. L’incendio forse è partito da un’elettrica”, con il sottotitolo “La Guardia Costiera olandese ritiene probabile che l’enorme rogo sia partito da una delle 25 vetture elettriche a bordo” (link intenzionalmente alterato; copia permanente). È falso.

Nel corpo dell’articolo, Bertera scrive che “Un portavoce della Guardia Costiera ha rivelato all’agenzia di stampa Reuters che l’origine del fuoco può essere ricondotta a un’auto elettrica a bordo della nave”. È falso anche questo.

Non c’è nessuna conferma che l’incendio sia partito da un’auto elettrica e la Guardia Costiera olandese non ha affatto rilasciato la dichiarazione riportata dal Corriere. Il liveblog della Guardia Costiera olandese dice esplicitamente che “la causa dell’incendio non è ancora nota” (“De oorzaak van de brand is nog onbekend”). Inoltre il sito Electrek ha chiamato la Guardia Costiera olandese, che ha dichiarato di non aver affatto attribuito l’incendio a un’auto elettrica.

Reuters, citata dal Corriere, conferma che la causa dell’incendio è ancora ignota e aggiunge che “un portavoce della Guardia Costiera aveva detto a Reuters che l’incendio era iniziato vicino a un’auto elettrica” (“The coastguard said on its website the cause of the fire was unknown, but a coastguard spokesperson had earlier told Reuters it began near an electric car”).

Da nessuna parte viene detto quello che scrive il Corriere, ossia che l’origine del fuoco possa essere ricondotta a un’auto elettrica.

La nave in questione, la Fremantle Highway, ha preso fuoco nel Mare del Nord. Trasporta 2832 auto a carburante e 25 auto elettriche dalla Germania all’Egitto. Una persona dell’equipaggio è morta.

---

2023/08/02 17:40. Un articolo di NOS news, segnalato nei commenti qui sotto da CheshireCat, precisa che le auto elettriche o ibride a bordo sono 498, non 25, su un totale di 3783 veicoli, non 2832 come annunciato inizialmente.

---

2023/08/18: 16:20. CleanTechnica segnala che le auto elettriche sono tutte intatte e l’incendio è partito da un altro punto della nave. Il direttore delle operazioni di recupero, Peter Berdowski, ha dichiarato alla stampa olandese che le 498 auto elettriche a bordo sono tutte intatte e che l’incendio è probabilmente iniziato sull’ottavo ponte dei dodici. Le auto elettriche erano situate molto più in basso.

Sono curioso di vedere quanti dei giornali, dei siti e degli hater che hanno diffuso con entusiasmo la notizia della presunta colpa delle auto elettriche pubblicheranno con altrettanta evidenza la smentita della balla che hanno disseminato.

2023/05/26

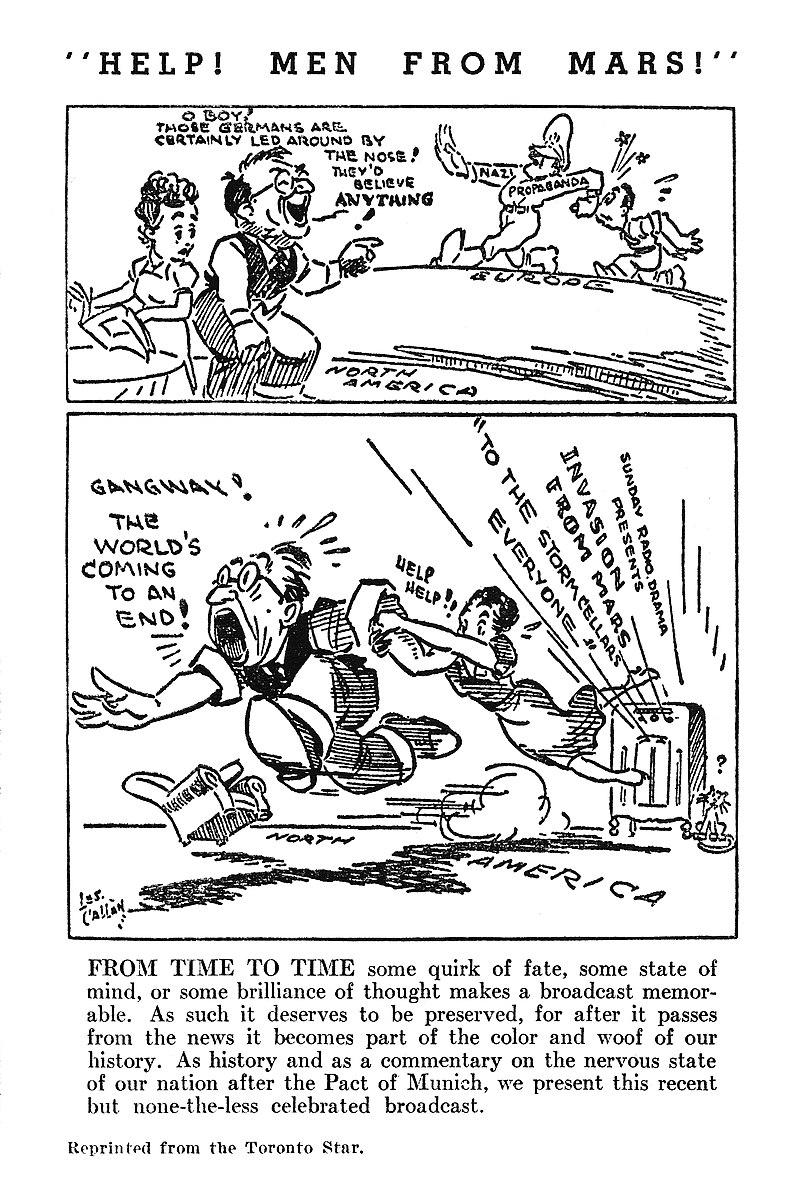

Podcast RSI - Story: Panico per "La Guerra dei Mondi" di Orson Welles, fake news storica

È disponibile subito il podcast di oggi de Il Disinformatico della Radiotelevisione Svizzera, scritto, montato e condotto dal sottoscritto: lo trovate presso www.rsi.ch/ildisinformatico (link diretto) e qui sotto.

Le puntate del Disinformatico sono ascoltabili anche tramite feed RSS, iTunes, Google Podcasts e Spotify.

Buon ascolto, e se vi interessano il testo di accompagnamento e i link alle fonti di questa puntata, sono qui sotto.

---

[CLIP: Rumore di rotativa]

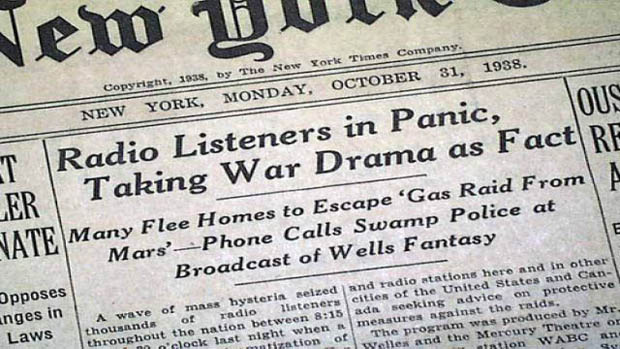

È il 31 ottobre 1938. Negli Stati Uniti, il New York Times denuncia in prima pagina un caso clamoroso di quella che oggi chiameremmo fake news, perpetrato attraverso un nuovo mezzo di telecomunicazione la cui immediatezza consente la diffusione rapidissima della disinformazione.

Il giorno precedente, un ventitreenne ha creato quella che il Times definisce una “ondata di isteria di massa” che ha coinvolto migliaia di persone, le cui telefonate hanno “sovraccaricato la polizia”. Il caos mediatico fa il giro del mondo e viene addirittura citato con disprezzo come “prova dello stato di decadenza e corruzione nel quale versa la democrazia” da un certo Adolf Hitler*.

* Discorso a Monaco, 8 novembre 1938.

Il mezzo di telecomunicazione in questione non è Internet, ovviamente, perché siamo appunto nel 1938: è la radio, che sta muovendo i suoi primi passi nella diffusione di notizie. E il ventitreenne al centro della denuncia è un attore, autore e regista emergente della rete radiofonica statunitense CBS. Si chiama Orson Welles.

[CLIP: Annuncio del programma di Welles: “The War of the Worlds, by H.G. Wells, starring Orson Welles and the Mercury Theater On the Air.”]

Questa è la storia della celeberrima diretta radiofonica de La Guerra dei Mondi, che Welles realizzò ottantacinque anni fa come se fosse una radiocronaca dell'invasione del nostro pianeta da parte di spietati marziani, armati di tecnologie distruttive letali. Quella diretta viene comunemente citata ancora oggi come esempio classico del potere dei mezzi di comunicazione. Ma le cose non stanno esattamente così.

Benvenuti alla puntata del 26 maggio 2023 del Disinformatico, il podcast della Radiotelevisione Svizzera dedicato alle notizie e alle storie strane dell’informatica. Io sono Paolo Attivissimo.

[SIGLA di apertura]

Sono le otto di sera della vigilia di Halloween del 1938. Negli Stati Uniti, la rete radiofonica Columbia Broadcasting Systems, o CBS come la chiamiamo noi nel ventunesimo secolo, trasmette un adattamento del libro di Herbert George Wells La Guerra dei Mondi. Questi adattamenti radiofonici sono ormai un appuntamento fisso della CBS.

[CLIP: Audio dal radiodramma “La Guerra dei Mondi” di Orson Welles. Annunciatore: “The Columbia Broadcasting System and its affiliated stations present Orson Welles and the Mercury Theater On the Air in ‘The War of the Worlds’ by H.G. Wells”]

Ma questo radiodramma è diverso dagli altri: ha quello che oggi chiameremmo un format molto particolare, scritto, diretto e interpretato dal giovane Orson Welles (che non è imparentato con H.G. Wells, l’autore del libro). Dopo la presentazione da parte dell’annunciatore, il radiodramma inizia come se fosse un programma musicale e poi sembra interrompersi per un notiziario urgente.

[CLIP in sottofondo: Annunciatore: “Ladies and gentlemen, we interrupt our program of dance music to bring you a special bulletin from the Intercontinental Radio News. At 20 minutes before eight Central Time, Professor Farrow of the Mount Jennings Observatory, Chicago, Illinois, reports observing several explosions of incandescent gas occurring at regular intervals on the planet Mars.”]

La voce dell’annunciatore parla dell’osservazione, da parte del professor Farrow dell’osservatorio di Mount Jennings, a Chicago, di numerose esplosioni di gas incandescente che si stanno verificando a intervalli regolari sul pianeta Marte. In un mondo che si trova sull’orlo della Seconda Guerra Mondiale, una notizia del genere non ha alcun motivo di essere trasmessa con così tanta urgenza, ma lasciamo stare.

Il programma torna alla musica, che viene però interrotta dalla notizia della caduta di un meteorite nel New Jersey e poi dall’annuncio di una lieve scossa di terremoto a Princeton. A questo punto la musica si ferma del tutto e si sente la voce di un radiocronista molto agitato:

[CLIP in sottofondo: Radiocronista: “There’s a jet of flames springing from that mirror and it leaps right at the advancing men. It strikes them head on. Lord! They’re turning into flames! It’s in the field over by the woods. The gas tanks of the automobiles… it’s spreading everywhere! They’re coming this way! Almost here now. About 20 yards to my righ...”]

L’uomo sembra parlare dal luogo della caduta del meteorite e racconta di un getto di fiamme che proviene da un macchinario situato dentro il cratere e incenerisce gli uomini che si stanno avvicinando. Fa in tempo a descrivere che l’incendio si sta propagando ai serbatoi di carburante dei veicoli nelle vicinanze e poi viene bruscamente interrotto.

È a questo punto che, secondo un mito diffusissimo, milioni di ascoltatori si riversano nelle strade degli Stati Uniti in preda al panico, intasando i centralini telefonici, convinti che sia in corso una vera invasione di marziani perché hanno scambiato il format del radiodramma per un notiziario reale, che prosegue per un’ora, con effetti sonori realistici e annunci sempre più drammatici che descrivono le fasi dell’attacco da Marte a tutto il pianeta.

Questa diretta de La Guerra dei Mondi e l’isteria di massa che avrebbe provocato diventeranno famosissime e verranno raccontate dalla serie antologica televisiva statunitense Studio One nel 1957* e di nuovo nel 1975 dal film drammatico La notte in cui l’America ebbe paura,** che contribuirà moltissimo a rinforzare il mito di un panico di massa scatenato per colpa di Orson Welles.

* Con i giovanissimi Warren Beatty, ventenne, e Ed Asner, ventottenne.

* The Night that Panicked America.

Ma oggi, anche grazie a Internet, sappiamo che non andò così. Eppure un conflitto fra due mondi, in un certo senso, ci fu lo stesso.

Mondi in collisione

Nei decenni ormai trascorsi da quella fatidica vigilia di Halloween del 1938, le ricerche degli storici hanno fatto emergere una storia molto diversa da quella “ondata di isteria di massa” descritta dal New York Times e dal “terrore in tutti gli Stati Uniti” annunciato l’indomani dal Daily News con tanto di foto e dichiarazioni di “vittime” traumatizzate dalla trasmissione.

Oggi possiamo contare per esempio su un’indagine del 2013, pubblicata in sintesi su Slate.com da due esperti di media e comunicazione presso il Muhlenberg College e la University of Maine;* possiamo basarci sui dati raccolti da W. Joseph Campbell, professore di comunicazioni alla American University e presentati in un podcast del 2022 pubblicato dal museo dell’aviazione e dello spazio Smithsonian; e possiamo contare su un libro dedicato alla vicenda, Broadcast Hysteria, scritto da Brad Schwartz.** Numerosi esperti, insomma, hanno raccolto i dati e i documenti dell’epoca, scoprendo che gettano una luce molto diversa sull’accaduto.

* Jefferson Pooley e Michael Socolow.

** Video su C-SPAN.

Per esempio, i rilevamenti d'ascolto fatti a scopo pubblicitario all'epoca durante la trasmissione indicarono che il 98% degli ascoltatori era sintonizzato su altri canali all'ora della messa in onda de La Guerra dei Mondi, e che nessuno del 2% degli intervistati che stavano ascoltando il programma disse di averlo scambiato per un notiziario. Insomma, non solo gli ascoltatori erano stati pochi, ma quei pochi avevano capito che si trattava di una finzione.

Poi c’è il fatto che gli avvenimenti descritti dal radiodramma avvengono tutti un po’ troppo in fretta. Nel giro di una quarantina di minuti si passa dalle prime timide avvisaglie di qualcosa di misterioso alla conquista marziana degli interi Stati Uniti: un po’ poco plausibile. E sarebbe bastato provare a cambiare canale per notare che le altre emittenti non stavano affatto diffondendo bollettini catastrofici.*

* La storia si ripete: dopo la chiusura di questo podcast, un falso account “verificato” su Twitter, di nome BloombergFeed, ha pubblicato la notizia falsa di un’esplosione al Pentagono, accompagnata da una fotografia altrettanto falsa, e questo tweet è stato ripreso su Twitter dalla testata RT (affiliata alla Russia), creando un panico momentaneo in Borsa; per evitarlo sarebbe bastato notare che nessun’altra testata giornalistica stava dando la notizia.

Infatti la documentazione dell’epoca segnala che alcune persone telefonarono alle stazioni radio, alla polizia e ai vigili del fuoco per assicurarsi di aver capito bene che stavano ascoltando un radiodramma presentato in un format da radiogiornale un po’ spiazzante.

Oltretutto il programma di Orson Welles inizia con un lungo prologo, letto da Welles stesso, che ambienta la vicenda nel 1939, cioè nel futuro per gli ascoltatori, ed è interrotto all’incirca a metà da un annunciatore che ricorda molto chiaramente agli ascoltatori che si tratta di un radiodramma.

[CLIP: Annunciatore: “You are listening to a CBS presentation of Orson Welles and the Mercury Theatre on the Air in an original dramatization of The War of the Worlds by H. G. Wells. The performance will continue after a brief intermission.” (a circa 40 minuti dall’inizio in questa registrazione)]

E di nuovo, alla fine del programma, Orson Welles in persona annuncia che la sua Guerra dei Mondi non è stata altro che “la versione radiofonica di indossare un lenzuolo, sbucare da un cespuglio e gridare ‘bu!’”. In fin dei conti è la vigilia di Halloween.

[CLIP in sottofondo: Orson Welles: “This is Orson Welles, ladies and gentlemen, out of character to assure you that The War of The Worlds has no further significance than as the holiday offering it was intended to be. The Mercury Theatre's own radio version of dressing up in a sheet and jumping out of a bush and saying Boo!”]

Non solo: i rapporti della polizia e degli ospedali di quella notte non segnalano nulla di insolito. Nessuna folla per strada.* Orson Welles e la CBS non verranno mai rimproverati o sanzionati formalmente dalle autorità,** e i giornali smetteranno di parlare della vicenda nel giro di pochi giorni.

* Ben Gross, del New York Daily News, scriverà nella sua autobiografia che le strade erano deserte mentre si dirigeva agli studi della CBS in tempo per il finale del radiodramma.

** Ci sarà solo un accordo informale con la Federal Communications Commission di non usare più finti notiziari flash.

Due anni più tardi uscirà uno studio accademico a firma di Hadley Cantril, dell’Università di Princeton, che cercherà di dimostrare la realtà del panico di massa, ma verrà smentito dalle ricerche successive.

Insomma, l’unica guerra dei mondi reale, in questa storia, è quella fra il mondo della stampa e quello della radio negli Stati Uniti della fine degli anni Trenta del secolo scorso. La radio aveva tolto ai giornali molti introiti pubblicitari, perché offriva una rapidità e un’immediatezza impossibile per le rotative, per cui la stampa colse l'occasione della trasmissione di Orson Welles per screditare il mezzo di comunicazione rivale, presentandolo come fonte inattendibile per le notizie.

Il New York Times pubblicò persino un editoriale, intitolato “Terror by Radio”, che biasimava i funzionari della CBS per aver permesso di intercalare “finzioni agghiaccianti” con “annunci di notizie, presentate esattamente nello stesso modo usato per le notizie reali”, e altre testate fecero eco. La radio, si diceva, era troppo giovane e immatura per un compito così importante come veicolare notizie. Una polemica che ricorda da vicino quella di oggi fra media tradizionali e Internet.

Da parte sua, Orson Welles non farà nulla per tentare di ridimensionare le notizie presentate dai giornali: la copertura mediatica lo sta facendo diventare famosissimo in tutto il mondo nonostante gli ascolti del suo radiodramma siano stati bassissimi, e la CBS sarà ben contenta di cavalcare l’ondata di articoli di giornale che dimostrano il potere della radio, cosa molto utile per incoraggiare gli inserzionisti pubblicitari a investire in spot radiofonici.

Era insomma nell’interesse di tutti che quella notizia falsa fosse creduta reale, e così divenne reale.

Lezione moderna

Una ventina d’anni dopo, Welles, ormai diventato famosissimo anche come regista cinematografico, racconterà la vicenda de La Guerra dei Mondi in un’intervista alla BBC con parole che sembrano scritte ieri: “Eravamo stufi del modo in cui tutto quello che passava da questa nuova scatola magica, la radio, veniva dato per buono. La gente è diffidente verso quello che legge sui giornali e quello che sente in giro, ma all’arrivo della radio, e oggi immagino della televisione, tutto quello che passava da quella nuova macchina veniva creduto. Per cui in un certo senso la nostra diretta fu un attacco alla credibilità di quella macchina. Volevamo che la gente capisse che non doveva accettare nessuna opinione predigerita e che non doveva dare per buono tutto quello che arrivava da quel canale”, disse Welles.

[In originale: “We were fed up with the way in which everything that came over this new magic box, the radio, was being swallowed. People, you know, do suspect what they read in the newspapers and what people tell them, but when the radio came, and I suppose now television, anything that came through that new machine was believed. So in a way our broadcast was an assault on the credibility of that machine; we wanted to people to understand that they shouldn't take any opinion pre-digested, and they shouldn't swallow everything that came through the tap, whether it was radio or not, but as I say, it was only a partial experiment, we had no idea the extent of the thing, and I certainly personally had no idea what it would mean to me.”]

Sostituite radio con Internet, e avete esattamente la situazione di oggi. I media tradizionali sono preoccupati per l’emorragia di denaro degli inserzionisti verso i social network e Google, che offrono alle aziende servizi di profilazione della clientela e di pubblicità mirata e personalizzata che sono impossibili per un’emittente radio o TV o per un giornale, e quindi questi media tradizionali spesso hanno una certa convenienza a presentare Internet come un luogo inattendibile, infestato da truffatori, maniaci e disinformatori. Non che queste cose manchino, ovviamente; ma non sono certo le uniche cose che si possono trovare online.

Giusto per fare un esempio pertinente, questo mito su Orson Welles diffuso a suo tempo dalla stampa oggi è smontabile e smentibile grazie al fatto che su Internet è possibile attingere agli archivi storici, riascoltare il programma originale, leggerne il copione per capire come era strutturato realmente, consultare le ricerche accademiche sul tema e anche sfogliare i giornali di allora. Senza Internet, questo livello di ricerca sarebbe impossibile non solo per il cittadino comune, ma anche per molti giornalisti.

La storia di quella diretta di ottantacinque anni fa, insomma, può essere vista sia come un esempio di come i media possono seminare e alimentare il panico, sia come una dimostrazione del modo in cui i media possono riscrivere la storia e inventarsi un panico che non ci fu. E in ogni caso, è una storia senza tempo, troppo ghiotta per essere dimenticata.

Fonti aggiuntive:

Deutsche Welle,

University of Chicago,

National Air and Space Museum,

Victoria University,

SmithsonianMag.com,

The Telegraph,

Humanities,

New York Times,

History.com,

British Newspaper Archive,

Newspapers.com,

UPI,

Il Post.

2023/03/23

Podcast RSI - Midjourney 5, le foto sintetiche diventano perfette. Anche per le fake news

È disponibile subito il podcast di oggi de Il Disinformatico della Radiotelevisione Svizzera, scritto, montato e condotto dal sottoscritto: lo trovate presso www.rsi.ch/ildisinformatico (link diretto) e qui sotto.

Le puntate del Disinformatico sono ascoltabili anche tramite feed RSS, iTunes, Google Podcasts e Spotify.

Buon ascolto, e se vi interessano il testo di accompagnamento e i link alle fonti di questa puntata, sono qui sotto.

---

[CLIP: “Hai mai messo in dubbio la natura della tua realtà?” dalla serie TV Westworld]

Pochi giorni fa è stata presentata la nuova versione di Midjourney, un software di generazione di immagini tramite intelligenza artificiale che finalmente produce immagini fotorealistiche sintetiche sostanzialmente indistinguibili dalle fotografie reali, prive dei difetti tipici delle foto sintetiche offerte sinora.

Questo spalanca le porte a un’ondata di fake news, di notizie false accompagnate e rinforzate da immagini che sembrano documentare, con la potenza emotiva tipica delle fotografie, degli eventi che in realtà non sono mai accaduti.

Per muoverci in questo strano, nuovo mondo dovremo imparare nuovi strumenti e dovremo abituarci, come i protagonisti della serie televisiva Westworld, a mettere in dubbio anche noi la natura della nostra realtà.

Benvenuti alla puntata del 24 marzo 2023 del Disinformatico, il podcast della Radiotelevisione Svizzera dedicato alle notizie e alle storie strane dell’informatica. Io sono Paolo Attivissimo.

[SIGLA di apertura]

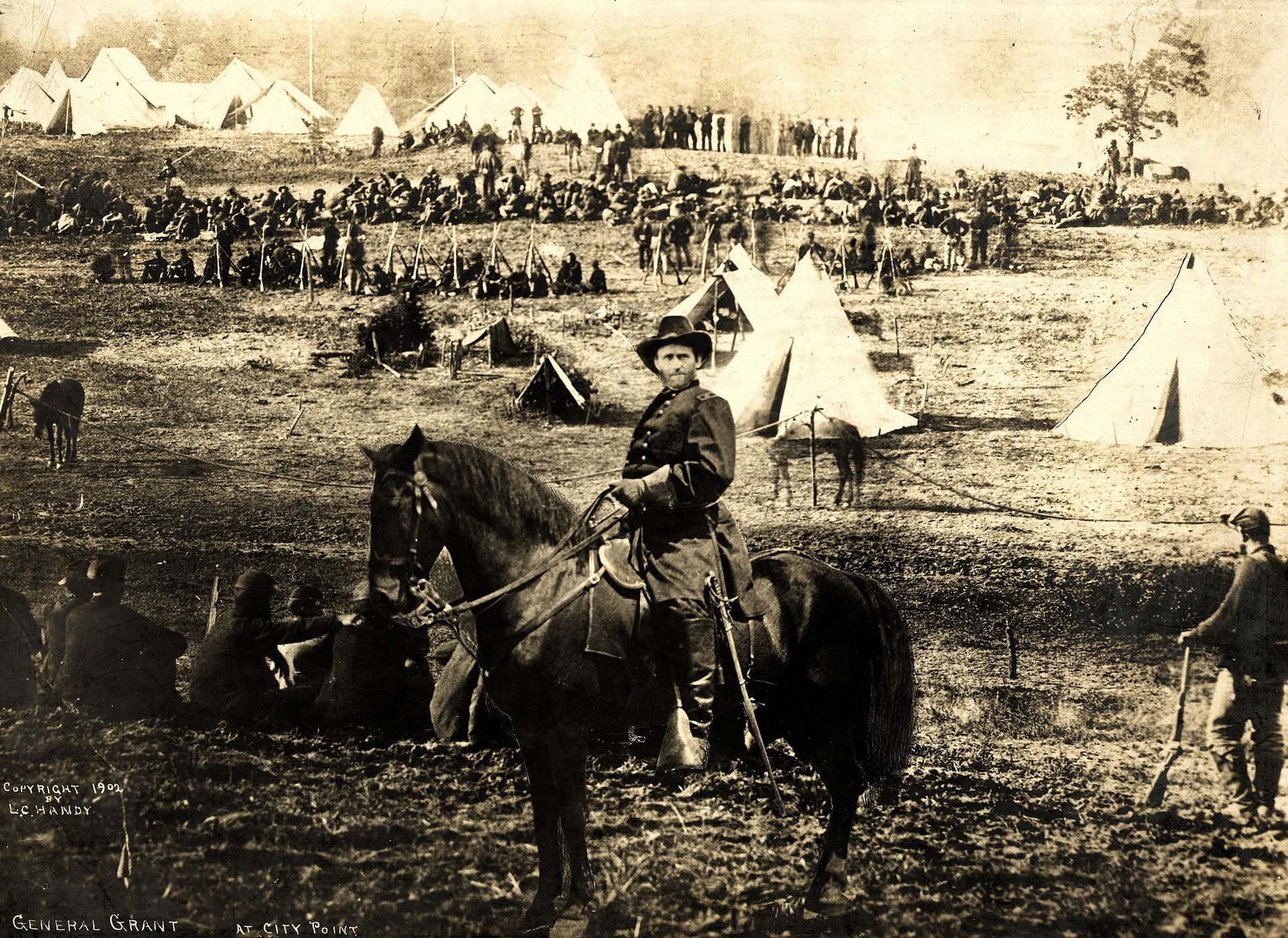

Le notizie false, e le foto false usate per renderle più credibili, non sono certo una novità. Le prime fotografie alterate per “documentare” eventi mai avvenuti o per creare immagini di propaganda risalgono al 1860: due celebri foto del presidente statunitense Lincoln e del generale Grant furono fabbricate mettendo le rispettive teste sui corpi di altre persone.

Nella prima metà del secolo scorso, Stalin e Mao Tse-Tung avevano l’abitudine di far rimuovere dalle fotografie ufficiali le persone cadute in disgrazia. Governi, famiglie reali e testate giornalistiche hanno spesso pubblicato immagini falsificate o pesantemente alterate. Ma nell’epoca pre-digitale queste manipolazioni richiedevano tempo e talento e lasciavano tracce vistose, facilmente riconoscibili anche a un occhio poco allenato.

Diffondere una fake news accompagnata da immagini di supporto, insomma, comportava un investimento alla portata di pochi. Con la digitalizzazione delle immagini queste manipolazioni sono diventate meno impegnative, ma sono rimaste comunque rilevabili da un occhio attento. Risoluzioni differenti delle varie parti dell’immagine, ombre orientate in modo sbagliato, pose innaturali erano i sintomi più frequenti di queste falsificazioni.

Con il passare del tempo e l’evoluzione della tecnologia, insomma, il costo di realizzazione è sceso progressivamente, mentre il realismo è aumentato ed è diventato sempre più difficile accorgersi delle alterazioni fotografiche. Ma il costo è rimasto significativo, per cui i fabbricanti di fake news si sono dovuti accontentare di usare foto reali tolte dal loro contesto originale: abbastanza efficaci, certo, ma blande e generiche, e soprattutto smentibili usando servizi come la ricerca per immagini di Google oppure Tineye.com che ne trovino la datazione e la provenienza originaria degli elementi usati per comporre la foto artefatta.

Il recente arrivo dei generatori di immagini basati su software di intelligenza artificiale e machine learning, come Dall-E o Stable Diffusion, e delle applicazioni di deepfake ha migliorato ulteriormente il realismo ma non ha risolto la questione del costo: i deepfake ben fatti richiedono potenza di calcolo e soprattutto un archivio personalizzato di immagini della persona che si vuole simulare, mentre le immagini fotorealistiche prodotte dai generatori di immagini hanno difetti ben riconoscibili con un pizzico di allenamento, come la forma mostruosa e incoerente delle mani delle persone, gli occhi spaiati e disallineati o i denti totalmente implausibili.

Ma tutto questo è cambiato con la versione 5 del generatore di immagini Midjourney, uscita il 15 marzo scorso, che partendo da una semplice descrizione testuale della foto desiderata produce immagini fotorealistiche false con luci e ombreggiature coerenti e con mani e occhi perfetti.

È giunto alla fine il momento, atteso ma non per questo meno spiazzante, di mettere in dubbio la natura della realtà di qualunque fotografia.

Lo si è visto subito, molto concretamente, quando Elliot Higgins, fondatore e direttore del collettivo internazionale d’indagine giornalistica Bellingcat, ha pubblicato su Twitter le foto dell’arresto dell’ex presidente degli Stati Uniti Donald Trump, viste in poche ore da alcuni milioni di persone.

“Trump arrestato, ci sono le foto!”

Sì, avete sentito bene: sono state pubblicate delle foto dell’arresto di Trump, che però non è avvenuto, perlomeno al momento in cui chiudo questo podcast. Le fotografie lo mostrano attorniato da poliziotti, mentre si divincola, con una manica della giacca strappata, corre inseguito dagli agenti, e infine siede sconsolato in una cella sporca e illuminata da una luce fredda e cupa.

Ma nessuna di queste immagini è reale: sono state tutte generate da Higgins usando Midjourney versione 5.

Higgins non le ha contrassegnate sovrapponendo scritte o avvertenze per avvisare che si tratta di immagini sintetiche, anche se ha scritto nel suo tweet iniziale che si trattava di immagini generate, e per il momento è abbastanza facile capire che sono false semplicemente perché descrivono un evento che nessuna fonte giornalistica, pro o contro Trump, ha confermato. Ma per le tante persone che si “informano”, per così dire, usando soltanto i social network o i forum di “informazione alternativa”, queste fotografie rischiano di essere credibili e di soffiare sul fuoco di Qanon e di altre organizzazioni complottiste e violente.

Dal 15 marzo scorso, insomma, non possiamo più fidarci di qualunque foto trovata online, perché esiste un modo facile e a buon mercato per generare migliaia di fotografie false ma estremamente credibili di qualunque persona o evento, reale o di fantasia. Foto che non possono essere smascherate dalla ricerca per immagini, visto che non sono realizzate componendo porzioni di immagini preesistenti, e che possono essere composte con estrema precisione, su misura, per esempio per screditare un avversario politico o appunto per generare fiumi di fake news su qualsiasi argomento.

Il costo irrisorio della produzione di queste immagini, combinato con la generazione automatica di infiniti testi su misura offerta da ChatGPT e simili, rende possibile un vero e proprio artigianato della disinformazione. Chiunque, con un minimo di competenza informatica, può creare e diffondere notizie false, corredate da fotografie estremamente convincenti, e guadagnare attraverso la pubblicità online incorporata in queste notizie. Tutti possiamo diventare bugiardi bottegai delle bufale, imprenditori dell’impostura, falsari fotografici provetti che avrebbero suscitato l’invidia di tanti governi e dittatori.

In un certo senso, Midjourney 5 è la democratizzazione definitiva della disinformazione. È anche la giustificazione perfetta per chiunque venga fotografato in situazioni imbarazzanti o illegali: gli basterà dire che la foto è falsa e generata dal computer per seminare il dubbio. Per contro, potrebbe anche essere la salvezza di chi viene ricattato con la minaccia di pubblicare foto intime, perché potrebbe liquidarle come produzioni sintetiche di Midjourney.

Per il momento, non c’è assolutamente nulla che impedisca l’uso di Midjourney in questo modo. Certo, le sue condizioni d’uso vietano immagini o prompt che siano “intrinsecamente mancanti di rispetto, aggressive o altrimenti causa di abusi”, e molti social network, come TikTok, richiedono che tutte le immagini falsificate fotorealistiche siano chiaramente indicate come tali, ma si tratta solo di raccomandazioni. E ci sono servizi come HiveModeration.com che cercano di riconoscere le foto sintetiche realistiche tramite sofisticate analisi matematiche, che rivelano dettagli ed errori che sfuggono all’occhio umano, ma non sono perfetti e poche persone li conoscono e meno ancora li usano.

Ma anche se tutti i generatori di immagini riuscissero a implementare regole e filtri infallibili contro la creazione di foto false e fuorvianti, ormai questi software possono essere installati su personal computer di fascia medio-alta, sfuggendo a qualunque regola o controllo. Stable Diffusion e Dreambooth possono essere addestrati a generare, su uno di questi personal computer, immagini fotorealistiche false di qualunque persona della quale si abbia un buon numero di foto del volto.

Sono false anche le foto che faccio io?

In teoria ci sarebbe una difesa perfetta contro queste falsificazioni: controllare le fonti. Se una fotografia non è autenticata da una fonte attendibile, non va creduta. Il problema è che le fonti attendibili, come per esempio le testate giornalistiche, si sono già lasciate ingannare in passato da foto false, anche nell’era pre-Midjourney, e hanno pubblicato immagini artefatte come quelle del cadavere di Osama bin Laden o della candidata alla Casa Bianca Sarah Palin. La voglia di scoop ha avuto la meglio sul metodo giornalistico, che richiede di usare solo foto di provenienza accertata.

C’è anche un altro problema decisamente inaspettato. Se non ci si può più fidare delle foto fatte da altri, perlomeno sembra logico potersi fidare delle foto fatte da noi. Ma non è così, perché è emerso che alcuni smartphone di Samsung falsificano le fotografie. Lo fanno specificamente nel caso delle foto fatte alla Luna, che è un soggetto particolarmente difficile da fotografare senza una fotocamera professionale. Samsung, infatti, ha ammesso che alcuni suoi modelli di smartphone sostituiscono la Luna fotografata con una sua immagine migliore che hanno in memoria. E non è l’unico caso, visto che era già successo con Huawei nel 2019.

Molti smartphone, inoltre, includono filtri e correzioni automatiche di cui spesso l’utente è inconsapevole: smorzano le imperfezioni della pelle e riorientano lo sguardo, per esempio. I puristi dicono che da sempre la fotografia è finzione, ma l’idea che una fotocamera sostituisca arbitrariamente parti dell’immagine è un livello di falsificazione nuovo, che va considerato con molta cautela.

Ci salvano i video. Almeno per ora

Oltre al controllo delle fonti, c’è anche un altro rimedio al fiume di falsi reso possibile da Midjourney 5: affidarsi ai video. È relativamente facile falsificare in modo fotorealistico una singola immagine fissa, ma non è altrettanto facile falsificare un video. Naturalmente esistono da tempo gli effetti speciali e gli effetti visivi digitali, ma realizzarli in modo perfetto in un video è estremamente oneroso e limitante.

Ma anche questa barriera sta crollando rapidamente. Runway Research ha presentato da poco Gen-2, un servizio online che genera interi video partendo da una descrizione testuale oppure da una singola foto. Per ora è limitato a durate di tre secondi ed è abbastanza rudimentale, ma lo era anche Midjourney solo pochi mesi fa. E un altro software, ModelScope, fa la stessa cosa di Gen-2 ma su un buon personal computer.

Gen-2 e ModelScope potrebbero essere l’inizio di un nuovo modo di fare cinema, nel quale non servono più budget colossali, scenografie e attori, ma solo e soprattutto idee interessanti. Ma l’esistenza di questi software per i falsi video low-cost significa che anche i video non possono essere più considerati prova oggettiva, a meno che siano autenticati da fonti estremamente attendibili e magari multiple.

Mai come oggi, insomma, servono persone esperte e affidabili che sappiano usare gli strumenti informatici moderni per verificare le notizie e le immagini che le accompagnano; servono giornalisti e redazioni al passo con i tempi digitali sempre più straordinari. Altrimenti anche noi, come gli androidi di Westworld, non sapremo più cosa è reale e cosa è sintetico, e dovremo mettere in dubbio la natura della nostra realtà.

Fonte aggiuntiva: Ars Technica.

2023/03/17

Stasera a Cureggio parlerò di fake news

Questa sera alle 21 sarò alla Sala Polivalente di Cureggio per parlare di fake news: come riconoscerle e come evitarle (e contrastarle), con esempi pratici e tecniche concrete.

L’ingresso è libero e non occorre prenotarsi.

2023/02/28

Sole 24 Ore: per “Milano-Napoli in auto elettrica” servono “due ore in più e 110 euro, contro i 76 del gasolio”. Se sei fesso, sì

In molti mi state segnalando questo articolo di Simonluca Pini sul Sole 24 Ore, il cui titolo dice che per fare “Milano-Napoli in auto elettrica” servono “due ore in più e 110 euro, contro i 76 del gasolio”.

Non lo linko per non fare favori alla crescente tendenza a scrivere articoli acchiappaclic privi di qualunque contenuto utile, e non lo cito neanche tramite Archive.is perché il testo completo è riservato agli abbonati.

Non mi sembra corretto commentarlo in dettaglio senza averlo letto integralmente, cosa che non posso fare perché non sono abbonato al Sole e non ho tempo per scavalcare le “protezioni” del giornale. Ne trovate delle sintesi su Vaielettrico e Everyeye (grazie ai lettori che me le hanno segnalate nei commenti).

Ma azzardo un paio di previsioni:

- lo “sperimentatore” ha usato le prime colonnine che ha trovato in giro, invece di scegliere quelle più a buon mercato o premunirsi con tessere che danno sconti fortissimi, e quindi ha pagato le tariffe massime;

- per la stima delle durate ha immaginato un viaggio a gasolio di 768 km senza soste, nemmeno per un tramezzino e una pipì. Non posso che complimentarmi per la sua inappetente brama di mortificarsi e per la resistenza della sua vescica simulata.

Bisognerebbe poi capire perché Simonluca Pini senta il bisogno di fare un viaggio di quasi 800 km da centro città a centro città in auto, quando esistono treni ad alta velocità che fanno lo stesso tragitto e in meno tempo. E non sono treni a gasolio. Invece di fantasticare di tenersi la pipì e guidare come un ossesso per sette ore di fila trangugiando un Camogli, Pini avrebbe potuto immaginare di sedersi in Frecciarossa e rilassarsi leggendo un buon libro. Ma non l’ha fatto, perlomeno nella parte pubblicamente leggibile dell’articolo.

A cosa servono articoli del genere? Il loro contenuto informativo è nullo. L’unica utilità di questa fuffa è attirare clic e fomentare discussioni inutili fra tifosi e hater e confortare gli umarell che hanno paura di qualunque cambiamento.

Intanto, da chi usa l’auto elettrica concretamente e intensamente per lavoro arrivano dati come questi:

La persona fa il tassista su lunghi tragitti, in Italia, e usa una Tesla Model X che ha un consumo piuttosto elevato (circa 250 Wh/km). Quei quasi 50.000 kWh consumati in un anno equivalgono quindi a circa 200.000 km di percorrenza e sono costati 1.758 euro (la persona ha la carica gratuita alle colonnine Tesla e paga mediamente 0,30 eurocent/kWh alle colonnine non Tesla e a casa).

Con il gasolio a 1,836 euro di prezzo medio (dati MISE) e ipotizzando ottimisticamente 19 km/litro come ha fatto Pini*, 200.000 km sarebbero 10.500 litri di carburante, quindi circa 19.000 euro di spesa. Togliendo i 1.758 euro di spesa di corrente, restano circa 17.000 euro di risparmio in un anno con l’auto elettrica** . Per non parlare dei risparmi su cambi olio, filtri antiparticolato, AdBlue e tagliandi su quei 200.000 km. Chilometri che, ripeto, sono stati fatti per lavoro e in un singolo anno, con buona pace di chi pensa che l’auto elettrica sia un giocattolo che non si può usare per grandi percorrenze.

E tutto questo, non dimentichiamolo, senza aver obbligato nessuno a respirare gas di scarico inquinanti e tossici.

* 76 euro di gasolio al prezzo medio di 1,836 euro/litro sono 41,39 litri di gasolio per percorrere 786 km: Simonluca Pini stima quindi un consumo di 18,99 km/litro. Per equità uso questo suo dato per il mio raffronto.

* Senza le

ricariche gratuite, alla sua tariffa domestica di 0,30 eurocent/kWh, il risparmio sarebbe stato

intorno ai 4.000 euro/anno. La persona è stata lungimirante e ha acquistato un veicolo il cui prezzo include ricariche gratuite a vita. Tariffe inferiori, e quindi risparmi maggiori, si possono avere usando pannelli solari o abbonamenti forfetari.

C’è chi ha capito che l’elettrico fa risparmiare, e che più lo usi e più risparmi, e chi si fida degli articoli acchiappaclic dei giornali.

2023/02/25

Come raccontar balle con un grafico: Istituto Bruno Leoni

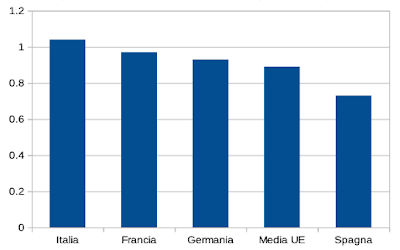

L’Istituto Bruno Leoni, che si definisce “Liberty Think Tank in Italy researching on Economics, Public Policy, Law, Regulation”, ha pubblicato su Twitter questo grafico che mette a confronto le accise sul carburante in alcuni paesi UE.

Tasse eccessive e politiche sbagliate hanno fatto lievitare i prezzi dei beni di uso quotidiano in Italia. Più concorrenza aiuterebbe invece a contenere i rincari

— Istituto Bruno Leoni (@istbrunoleoni) December 23, 2022

Quali rimedi? Leggi la nostra ricerca 💸👉🏻 https://t.co/MHfXwVRIuS#SpecialReportIBL pic.twitter.com/7gVoMycpzN

La differenza fra le accise italiane e quelle degli altri paesi sembra davvero impressionante (la barra italiana è circa 10 volte più alta di di quella spagnola, finché ci si rende conto che lo zero del grafico è in realtà nascosto e il grafico parte da 0,7. Certo, i numeri sono indicati nel grafico, ma visivamente quel grafico mostra delle proporzioni totalmente diverse da quelle reali.

Tre secondi passati in LibreOffice mostrano il grafico reale:

Vedo solo due possibili spiegazioni per quel grafico: inettitudine abissale o intento di ingannare.

Ringrazio Matteo Flora per la colorita segnalazione.

---

2023/02/26 22:15. Leoniblog.it ha risposto pubblicamente.

2023/01/17

Rainews fa fake news: pubblica un video del 2021 spacciandolo per immagini dello schianto aereo in Nepal del 15 gennaio

Rainews ha pubblicato un articolo (copia permanente) incentrato su quello che presenta come “nuovo video del disastro”, riferendosi alla caduta di un aereo ATR-72 avvenuta in Nepal il 15 gennaio scorso.

Ma il video si riferisce a un incidente aereo avvenuto nel 2021 a Mosca:

Il controllo delle fonti sta a zero. La pornografia del dolore, invece, va a mille. Non è questo il giornalismo di cui abbiamo bisogno per difenderci dalla disinformazione.

Ringrazio Daniele per la segnalazione.

23:05. L’articolo è stato rimosso qualche ora fa. Ho ricevuto una telefonata di scuse e contrizione da parte di un redattore. Apprezzo il gesto: però apprezzerei ancora di più se si facesse qualcosa per evitare in partenza errori di metodo di questo genere.

Fonte aggiuntiva: AVHerald.

2022/11/28

Elon Musk posta uno screenshot falso della CNN e viola le regole di Twitter. Pensa che sia divertente disseminare fake news

Il neo-boss di Twitter scherza col fuoco in una nuova dimostrazione di irresponsabilità. Ha pubblicato ai suoi 119 milioni di follower un tweet che mostra una falsa schermata della CNN, nella quale sembra che Don Lemon, uno dei conduttori del canale televisivo, stia dando la notizia che “Musk potrebbe mettere a repentaglio la libertà di espressione su Twitter dando alla gente la possibilità di esprimersi liberamente”.

L’intento è presumibilmente umoristico, ma l’uso del vero logo della CNN e

dell’immagine di un vero conduttore della rete televisiva rischia di fare

disinformazione, tant’è vero che il servizio di fact-checking di

Twitter ha segnalato che

il tweet del CEO di Twitter viola le regole di Twitter, notando che il

falso screenshot ha iniziato a circolare ad aprile 2022 ed ha tratto in

inganno molte persone che hanno creduto che fosse reale, come nota Associated Press. CNN ha

smentito

di aver mai trasmesso una notizia del genere, allegando uno screenshot che

include l’avviso di Twitter che segnala la violazione delle sue regole.

Di fatto Musk sta simulando una schermata di un’emittente reale senza

dichiarare che è una parodia. Ricordate quando Musk impose a tutti di dichiarare esplicitamente gli account parodia, quando era lui il parodiato? Si ritiene al

di sopra delle sue stesse regole, a quanto pare. E chiaramente non ha

comprensione del proprio peso mediatico.

Per tutta risposta, Musk ha

tweetato

“Lmaoooo”.

Come nota David Puente, sarebbe altrettanto divertito se qualcuno con cento

milioni di follower diffondesse uno screenshot nel quale si dice che Musk è un

pedofilo?

Non è la prima volta che Elon Musk pubblica notizie false su Twitter da quando ne è CEO. Il 30 ottobre scorso aveva diffuso in un tweet la notizia totalmente inventata secondo la quale Paul Pelosi, marito della Speaker della Camera dei Rappresentanti statunitense Nancy Pelosi, aggredito e percosso violentemente in casa pochi giorni prima da un uomo che voleva aggredire la moglie per motivi politici, sarebbe stato in realtà ubriaco e avrebbe avuto una colluttazione con l’uomo per motivi legati a prestazioni sessuali a pagamento. La “notizia” era stata inventata da un sito noto per le sue fantasie complottiste. Musk ha poi rimosso il tweet, ma il danno era ormai fatto.

Con un CEO del genere, non stupisce che gli inserzionisti si stiano ritirando da Twitter in massa. Secondo NPR, che cita un rapporto di Media Matters, metà dei 100 inserzionisti pubblicitari più importanti di Twitter non stanno più facendo pubblicità sul sito. Si tratta di organizzazioni che hanno speso su Twitter oltre 750 milioni di dollari soltanto nel 2022. Altri sette inserzionisti, che ammontano a oltre 225 milioni di dollari dal 2020, hanno ridotto la propria presenza pubblicitaria quasi a zero. Musk ha ammesso che Twitter ha visto un “massiccio” calo nei ricavi e ha incolpato imprecisati “attivisti” che avrebbero fatto pressioni sugli inserzionisti pubblicitari.

Chevrolet, Chipotle Mexican Grill, Inc., Ford, Jeep, Kyndryl, Merck & Co. e Novartis AG hanno tutte pubblicato dichiarazioni di interruzione delle proprie pubblicità su Twitter oppure sono state segnalate e confermate in tal senso, dice NPR, aggiungendo che 12 grandi case farmaceutiche hanno smesso di fare pubblicità, probabilmente in seguito al disastro del falso account “verificato” di Eli Lilly, che aveva annunciato insulina gratis per tutti, facendo precipitare le azioni della vera casa farmaceutica.

Nel frattempo, SpaceX ha comprato spazi pubblicitari su Twitter per reclamizzare le parabole satellitari per trasmissione dati Starlink, secondo CNBC e Reuters, ma l’importo sarebbe piccolo (intorno ai 160.000 dollari). Musk ha dichiarato che SpaceX ha fatto lo stesso tipo di spesa anche su Facebook, Instagram e Google.

.gif)